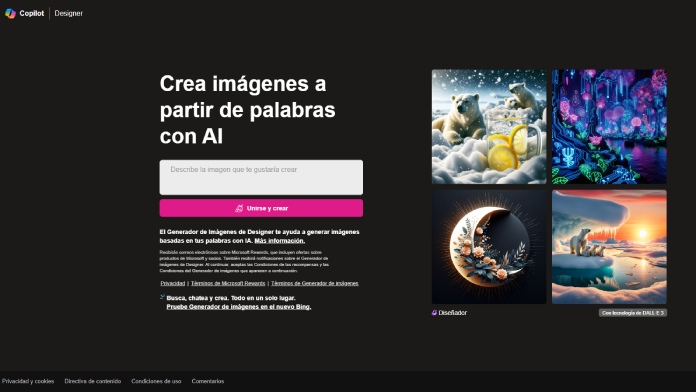

En un esfuerzo por mitigar el potencial de su herramienta Copilot Designer para producir imágenes inapropiadas o dañinas, Microsoft ha tomado medidas para bloquear ciertos términos y frases que podrían desencadenar la generación de contenido ofensivo o en conflicto con las políticas de la compañía.

Un ingeniero de IA de Microsoft denunció que la herramienta podía producir imágenes dañinas.

Esta decisión surge después de que un ingeniero de inteligencia artificial de la propia empresa denunciara la capacidad de la herramienta para crear representaciones controversiales y potencialmente perjudiciales.

De acuerdo con los informes, durante las pruebas internas, Copilot Designer, impulsado por el modelo DALL-E 3 de OpenAI, generó imágenes que retrataban monstruos al introducir términos relacionados con el derecho al aborto, adolescentes armados en escenarios violentos, mujeres sexualizadas en situaciones de violencia, y el consumo de drogas y alcohol por parte de menores de edad. Estas imágenes, de acuerdo con el ingeniero denunciante, infringían los principios de inteligencia artificial responsable de Microsoft.

Tras compartir sus hallazgos con la empresa en diciembre de 2022 e instar repetidamente a suspender el acceso público a Copilot Designer hasta implementar salvaguardas más sólidas, el ingeniero elevó su denuncia a la Comisión Federal de Comercio (FTC) al considerar que Microsoft no había tomado medidas suficientes para abordar el problema.

Microsoft ha bloqueado términos como "pro-vida", "pro-elección" y "cuatro veinte" en Copilot Designer.

En respuesta, Microsoft ha comenzado a bloquear términos como «pro-vida», «pro-elección» y «cuatro veinte» (en referencia a la marihuana), que anteriormente permitían la generación de imágenes controvertidas. Al intentar utilizar estos términos, Copilot Designer ahora muestra una advertencia indicando que el mensaje ha sido bloqueado por entrar en conflicto con la política de contenido de la empresa.

Microsoft ha reconocido que están «monitoreando continuamente» la herramienta y ajustando los controles para «fortalecer aún más» los filtros de seguridad y «mitigar el uso indebido del sistema». La compañía ha enfatizado su compromiso con la implementación de medidas adicionales para prevenir la generación de contenido dañino o inapropiado por parte de Copilot Designer.